Ele pode fornecer modelos grandes de linguagem (LLMs), como ChatGPT e Google Bard alguns Respostas decentes para certos tipos de perguntas, mas, ironicamente, esses computadores são muito ruins em computação. O Google tem uma nova solução para tentar obter modelos de linguagem para realizar tarefas simples, como matemática, certo: obter IA Escreva um programa. O Google diz que agora, quando você pede ao Bard uma tarefa “computacional” como matemática ou manipulação de strings, em vez de mostrar a saída de um modelo de linguagem, esse modelo de linguagem escreverá um programa, executará esse programa e mostrará a saída disso programa para o usuário como uma resposta.

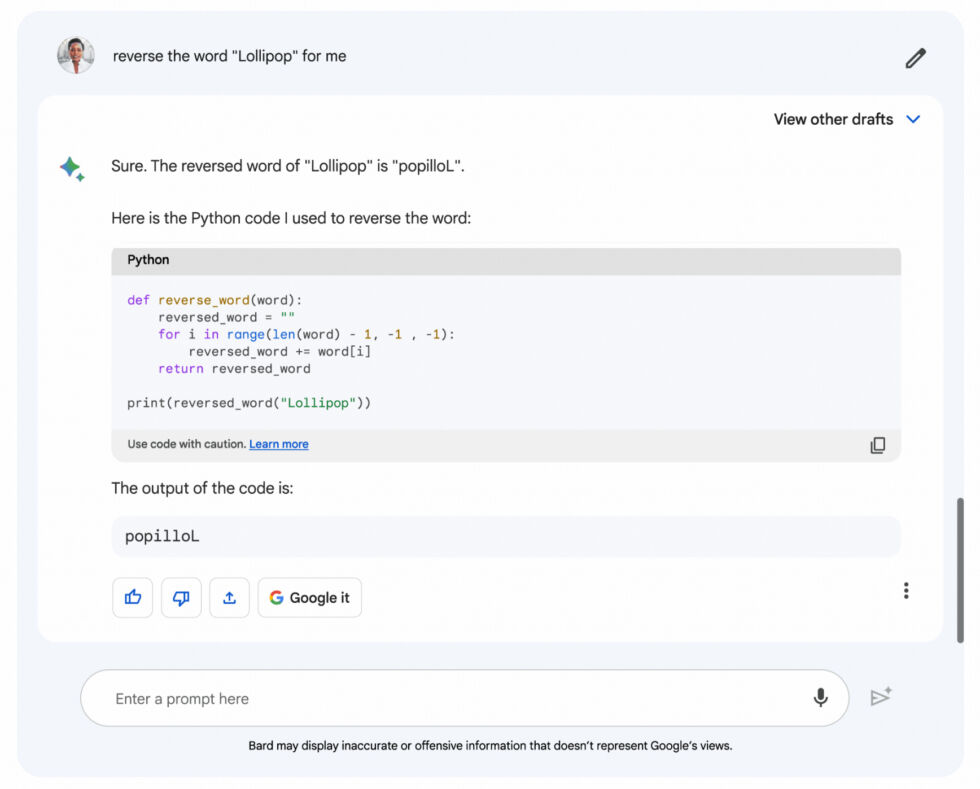

Uma postagem no blog do Google fornece um exemplo de entrada que “inverte a palavra ‘pirulito’ para mim”. O ChatGPT inverte essa questão e dá a resposta incorreta “pillopoL”, porque os modelos de linguagem veem o mundo em pedaços de palavras, ou “símbolos”, e eles não são muito bons nisso. Aqui está um exemplo de saída do Bard:

Você obtém a saída correta como “popilloL”, mas o mais interessante é que também Inclui código python Escrevi para responder à pergunta. Isso é ótimo para pessoas interessadas em programar para ver o que está por trás do capô, mas uau, essa é provavelmente a saída mais assustadora de todas para pessoas normais. Também não é particularmente relevante. Imagine se o Gmail mostrasse um bloco de código quando você apenas pedisse para buscar o e-mail. É estranho. Apenas faça o trabalho que você pediu, legal.

O Google compara um modelo de IA que escreve um programa a humanos fazendo divisões longas, pois é um modo diferente de pensar:

Esta abordagem é inspirada por um dualismo bem estudado na inteligência humana, que é abordado especificamente no livro de Daniel Kahneman Pensando rápido e devagarSepare o pensamento do “Sistema 1” e do “Sistema 2”.

- O pensamento do Sistema 1 é rápido, intuitivo e fácil. Quando um músico de jazz improvisa na hora ou quando alguém pensa em uma palavra e a vê aparecer na tela, está usando o pensamento do Sistema 1.

- Em contraste, o pensamento do Sistema 2 é lento, deliberado e trabalhoso. Quando você faz uma divisão longa ou aprende a tocar um instrumento, está usando o Sistema 2.

Nessa analogia, o LLM pode ser visto como operando apenas no Sistema 1 – produzindo um texto rapidamente, mas sem pensar muito. Isso leva a alguns recursos incríveis, mas pode ser insuficiente de maneiras surpreendentes. (Imagine que você está tentando resolver um problema de matemática usando o Sistema 1 sozinho: você não pode parar e fazer as contas, você só precisa anotar a primeira resposta que vier à mente.) Os cálculos clássicos estão intimamente alinhados com o Sistema 2 pensamento: é uma fórmula e um processo inflexível, mas a sequência certa de etapas pode levar a resultados impressionantes, como soluções de divisão longas.

O Google diz que o método “código em tempo real” também será usado para perguntas como: “Quais são os fatores primos de 15.683.615?” e “Calcule a taxa de crescimento de minhas economias”. A empresa diz: “Até agora, vimos esse método melhorar a precisão das respostas de Bard a problemas matemáticos e de palavras baseados em numeramento em nossos conjuntos de dados de desafio interno em cerca de 30%”. Como de costume, o Google avisa Bard que “você pode não acertar” por interpretar mal sua pergunta ou apenas, como todos nós, escrever um código que não funciona na primeira vez.

Bard está codificando rapidamente as respostas agora, se você quiser tentar em bard.google.com.

“Estudante amigável. Jogador certificado. Evangelista de mídia social. Fanático pela Internet. Cai muito. Futuro ídolo adolescente.”